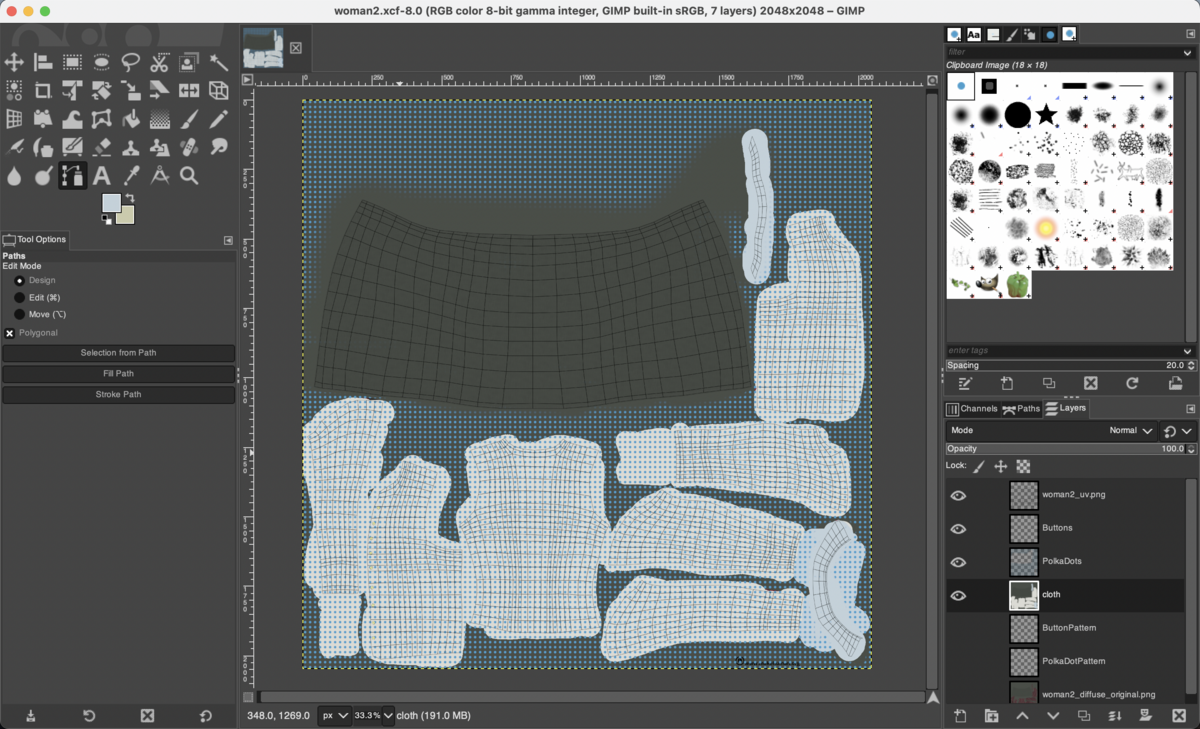

MPFB(MakeHuman Plugin For Blender)でつくった人物モデルの衣装を着せ替えできるよう、衣装テキスチャーをGIMPで制作出来るか実験中。

人物モデルをUV展開して、そのUV画像データをGIMPに読み込んで、マルチレイヤーでテキスチャーを描いていく地道な作業。結構、時間がかかる。やり直しを何度も繰り返し、途中で心が折れそうにななったが、なんとか、完成。今回、ノーマルマップはMPFBが生成したものをそのまま活用し、ディフューズの方だけ制作。

Kritaでも衣装テキスチャー制作を試したが、私にはGIMPのUIの方が扱いやすいと思った。GIMPだと360度カメラで撮影した写真のHDRI化みたいな作業もできて、テキスチャー制作以外に、Blenderで出来ない他の多くの作業も補完できる。

この実験を通して感じたこと:

メタバースが話題で、なぜか、XRデバイスやUnityみたいなゲーム開発環境ばかり注目されるが、実際にメタバース制作となると、3Dモデル、アニメーション、テキスチャーの制作の方が比重が高い気がする。

個人的には、リアルタイムレンダリングにこだわってCG品質を妥協するのではなく、CG品質にこだわった方がメタバースは成功する気がする。仮想世界なのだから、リアル感が重要で、顔の微妙な表情とか、照明や影を意識したカメラのベストアングルとか、その辺で、人間の感性に訴えかけるような何か。それがあれば、世代を問わずメタバースは受け入れられると思う。

ウエブ(Three.js/WebGL)で超ローポリーな3Dモデルを描画し、3DCGアニメ動画を組み合わせ、動画の方は思いっきり品質を上げる。そういう感じのメタバースが良いのでは?動画であれば、スマホ機種間の性能差を意識することなく、すべてのデバイスで同じ品質となる。消費電力も少なく、SDGsの観点でも良い。